Обзор градиентных методов в задачах математической оптимизации. Градиентные методы безусловной оптимизации

В задаче безусловной оптимизации отсутствуют ограничения.

Напомним, что градиентом многомерной функции называют вектор, который аналитически выражается геометрической суммой частных производных

Градиент скалярной функции F (X ) в некоторой точке направлен в сторону наискорейшего возрастания функции и ортогонален линии уровня (поверхности постоянного значения F (X ), проходящей через точку X k ). Вектор, противоположный градиенту антиградиент направлен в сторону наискорейшего убывания функции F (X ). В точке экстремума grad F (X )= 0.

В градиентных методах движение точки при поиске минимума целевой функции описывается итерационной формулой

где k параметр шага на k -й итерации вдоль антиградиента. Для методов восхождения (поиска максимума) нужно двигаться по градиенту.

Различные варианты градиентных методов отличаются друг от друга способом выбора параметра шага, а также учета направления движения на предыдущем шаге . Рассмотрим следующие варианты градиентных методов: с постоянным шагом, с переменным параметром шага (дроблением шага), метод наискорейшего спуска и метод сопряженных градиентов.

Метод с постоянным параметром шага. В этом методе параметр шага постоянен на каждой итерации. Возникает вопрос: как практически выбрать величину параметра шага? Достаточно малый параметр шага может привести к неприемлемо большому количеству итераций, необходимых для достижения точки минимума. С другой стороны, слишком большой параметр шага может привести к проскакиванию точки минимума и к колебательному вычислительному процессу около этой точки. Указанные обстоятельства являются недостатками метода. Поскольку невозможно заранее угадать приемлемое значение параметра шага k , то возникает необходимость использования градиентного метода с переменным параметром шага.

По мере приближения к оптимуму вектор градиента уменьшается по величине, стремясь к нулю, поэтому при k = const длина шага постепенно уменьшается. Вблизи оптимума длина вектора градиента стремится к нулю. Длина вектора или норма в n -мерном евклидовом пространстве определяется по формуле

,

где n

число переменных.

,

где n

число переменных.

Варианты остановки процесса поиска оптимума:

C практической точки зрения удобней пользоваться 3-им критерием остановки (поскольку представляют интерес значения параметров проектирования), однако для определения близости точки экстремума нужно ориентироваться на 2-й критерий. Для остановки вычислительного процесса можно использовать несколько критериев.

Рассмотрим пример. Найти минимум целевой функции F (X ) = (x 1 2) 2 + (x 2 4) 2 . Точное решение задачи X*= (2,0;4,0). Выражения для частных производных

,

,

.

.

Выбираем шаг k = 0,1. Осуществим поиск из начальной точки X 1 = . Решение представим в виде таблицы.

Градиентный метод с дроблением параметра шага. В этом случае в процессе оптимизации параметр шага k уменьшается, если после очередного шага целевая функция возрастает (при поиске минимума). При этом часто длина шага дробится (делится) пополам, и шаг повторяется из предыдущей точки. Так обеспечивается более точный подход к точке экстремума.

Метод наискорейшего спуска. Методы с переменным шагом являются более экономичными с точки зрения количества итераций. В случае если оптимальная длина шага k вдоль направления антиградиента является решением одномерной задачи минимизации, то такой метод называется методом наискорейшего спуска. В этом методе на каждой итерации решается задача одномерной минимизации:

F(X k+1 )=F(X k k S k )=min F( k ), S k = F(X);

k >0

.

.

В данном методе движение в направлении антиградиента продолжается до достижения минимума целевой функции (пока значение целевой функции убывает). На примере рассмотрим, как аналитически может быть записана на каждом шаге целевая функция в зависимости от неизвестного параметра

Пример. min F (x 1 , x 2 ) = 2x 1 2 + 4x 2 3 – 3. Тогда F (X )= [ 4x 1 ; 12x 2 2 ]. Пусть точка X k = , следовательно F (X )= [ 8; 12], F (X k S k ) =

2(2 8 ) 2 + 4(1 12 ) 3 3. Необходимо найти , доставляющее минимум данной функции.

Алгоритм метода наискорейшего спуска (для поиска минимума)

Начальный шаг . Пусть константа остановки. Выбрать начальную точку X 1 , положить k = 1 и перейти к основному шагу.

Основной шаг . Если || gradF (X )||< , то закончить поиск, в противном случае определить F (X k ) и найти k оптимальное решение задачи минимизации F (X k k S k ) при k 0. Положить X k +1 = X k k S k , присвоить k =

k + 1 и повторить основной шаг.

Для поиска минимума функции одной переменной в методе наискорейшего спуска можно использовать методы унимодальной оптимизации. Из большой группы методов рассмотрим метод дихотомии (бисекции) и золотого сечения. Суть методов унимодальной оптимизации заключается в сужении интервала неопределенности размещения экстремума.

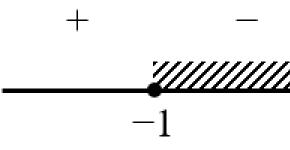

Метод дихотомии (бисекции) Начальный шаг. Выбирают константу различимости и конечную длину интервала неопределенности l . Величина должна быть по возможности меньшей, однако позволяющей различать значения функции F ( ) и F ( ) . Пусть [ a 1 , b 1 ] начальный интервал неопределенности. Положить k =

Основной этап состоит из конечного числа однотипных итераций.

k-я итерация.

Шаг 1. Если b k a k l , то вычисления заканчиваются. Решение x * = (a k + b k )/2. В противном случае

,

,

.

.

Шаг 2. Если F ( k ) < F ( k ), положить a k +1 = a k ; b k +1 = k . В противном случае a k +1 = k и b k +1 = b k . Присвоить k = k + 1 и перейти к шагу 1.

Метод золотого сечения. Более эффективный метод, чем метод дихотомии. Позволяет получить заданную величину интервала неопределенности за меньшее число итераций и требует меньшего числа вычислений целевой функции. В этом методе новая точка деления интервала неопределенности вычисляется один раз. Новая точка ставится на расстоянии

= 0,618034 от конца интервала.

Алгоритм метода золотого сечения

Начальный шаг. Выбрать допустимую конечную длину интервала неопределенности l > 0. Пусть [ a 1 , b 1 ] начальный интервал неопределенности. Положить 1 = a 1 +(1 )(b 1 a 1 ) и 1 = a 1 + (b 1 a 1 ) , где = 0,618 . Вычислить F ( 1 ) и F ( 1 ) , положить k = 1 и перейти к основному этапу.

Шаг 1. Если b k a k l , то вычисления заканчиваются x * = (a k + b k )/ 2. В противном случае если F ( k ) > F ( k ) , то перейти к шагу 2; если F ( k ) F ( k ) , перейти к шагу 3.

Шаг 2. Положить a k +1 = k , b k +1 = b k , k +1 = k , k +1 = a k +1 + (b k +1 – a k +1 ). Вычислить F ( k +1 ), перейти к шагу 4.

Шаг 3. Положить a k +1 = a k , b k +1 = k , k +1 = k , k +1 = a k +1 + (1 )(b k +1 – a k +1 ). Вычислить F ( k +1 ).

Шаг 4. Присвоить k = k + 1, перейти к шагу 1.

На первой итерации необходимы два вычисления функции, на всех последующих только одно.

Метод сопряженных градиентов (Флетчера-Ривса). В этом методе выбор направления движения на k + 1 шаге учитывает изменение направления на k шаге. Вектор направления спуска является линейной комбинацией направления антиградиента и предыдущего направления поиска. В этом случае при минимизации овражных функций (с узкими длинными впадинами) поиск идет не перпендикулярно оврагу, а вдоль него, что позволяет быстрее прийти к минимуму. Координаты точки при поиске экстремума методом сопряженных градиентов рассчитываются по выражению X k +1 = X k V k +1 , где V k +1 – вектор, рассчитываемый по следующему выражению:

.

.

На первой итерации обычно полагается V = 0 и выполняется поиск по антиградиенту, как в методе наискорейшего спуска. Затем направление движения отклоняется от направления антиградиента тем больше, чем значительнее менялась длина вектора градиента на последней итерации. После n шагов для коррекции работы алгоритма делают обычный шаг по антиградиенту.

Алгоритм метода сопряженных градиентов

Шаг 1. Ввести начальную точку Х 0 , точность , размерность n .

Шаг 2. Положить k = 1.

Шаг 3. Положить вектор V k = 0.

Шаг 4. Вычислить grad F (X k ).

Шаг 5. Вычислить вектор V k +1.

Шаг 6. Выполнить одномерный поиск по вектору V k +1.

Шаг 7. Если k < n , положить k = k + 1 и перейти к шагу 4, иначе к шагу 8.

Шаг 8. Если длина вектора V меньше , окончить поиск, иначе перейти к шагу 2.

Метод сопряженных направлений является одним из наиболее эффективных в решении задач минимизации. Метод в совокупности с одномерным поиском часто практически используется в САПР. Однако следует отметить, что он чувствителен к ошибкам, возникающим в процессе счета.

Недостатки градиентных методов

В задачах с большим числом переменных трудно или невозможно получить производные в виде аналитических функций.

При вычислении производных по разностным схемам возникающая при этом ошибка, особенно в окрестностях экстремума, ограничивает возможности такой аппроксимации.

Лекция № 8

Градиентные методы решения задач нелинейного программирования. Методы штрафных функций. Приложения нелинейного программирования к задачам исследования операций.

Задачи без ограничений. Градиентным методом можно решать, вообще говоря, любую нелинейную задачу. Однако при этом находится лишь локальный экстремум. Поэтому целесообразнее применять этот метод при решении задач выпуклого программирования, в которых любой локальный экстремум, является одновременно и глобальным (см. теорему 7.6).

Будем рассматривать задачу максимизации нелинейной дифференцируемой функции f (x ). Суть градиентного поиска точки максимума х * весьма проста: надо взять произвольную точку х 0 и с помощью градиента , вычисленного в этой точке, определить направление, в котором f (х ) возрастает с наибольшей скоростью (рис. 7.4),

а затем, сделав небольшой шаг в найденном направлении, перейти в новую точку x i . Потом снова определить наилучшее направление для перехода в очередную точку х 2 и т. д. На рис. 7.4 поисковая траектория представляет собой ломаную х 0 , x 1 , х 2 ... Таким образом, надо построить последовательность точек х 0 , x 1 , х 2 ,...,x k , ... так, чтобы она сходилась к точке максимума х *, т. е. для точек последовательности выполнялись условия

![]()

Градиентные методы, как правило, позволяют получать точное решение за бесконечное число шагов и только в некоторых случаях - за конечное. В связи с этим градиентные методы относят к приближенным методам решения.

Движение из точки х k в новую точку x k+1 осуществляется по прямой, проходящей через точку х k и имеющей уравнение

![]() (7.29)

(7.29)

где λ k - числовой параметр, от которого зависит величина шага. Как только значение параметра в уравнении (7.29) выбрано: λ k =λ k 0 , так становится определенной очередная точка на поисковой ломаной.

Градиентные методы отличаются друг от друга способом выбора величины шага - значения λ k 0 параметра λ k . Можно, например, двигаться из точки в точку с постоянным шагом λ k = λ, т. е. при любом k

Если при этом окажется, что ![]() , то следует возвратиться в точку и уменьшить значение параметра, например до λ

/2.

, то следует возвратиться в точку и уменьшить значение параметра, например до λ

/2.

Иногда величина шага берется пропорциональной модулю градиента.

Если ищется приближенное решение, то поиск можно прекратить, основываясь на следующих соображениях. После каждой серии из определенного числа шагов сравнивают достигнутые значения целевой функции f (x ). Если после очередной серии изменение f (x ) не превышает некоторого наперед заданного малого числа , поиск прекращают и достигнутое значение f (x ) рассматривают как искомый приближенный максимум, а соответствующее ему х принимают за х *.

Если целевая функция f (x ) вогнутая (выпуклая), то необходимым и достаточным условием оптимальности точки х * является равенство нулю градиента функции в этой точке.

Распространенным является вариант градиентного поиска, называемый методом наискорейшего подъема. Суть его в следующем. После определения градиента в точке х к

движение вдоль прямой ![]() производится до точки х к+

1 , в которой достигается максимальное значение функции f

(х

) в направлении градиента . Затем в этой точке вновь определяется градиент, и движение совершается по прямой в направлении нового градиента до точки х к+

2 , в которой достигается максимальное в этом направлении значение f

(x

). Движение продолжается до тех пор, пока не будет достигнута точка х

*, соответствующая наибольшему значению целевой функции f

(x

). На рис. 7.5 приведена схема движения к оптимальной точке х

* методом наискорейшего подъема. В данном случае направление градиента в точке х k

является касательным к линии уровня поверхности f

(х

) в точке х к+

1 , следовательно, градиент в точкех к+

1 ортогонален градиенту (сравните с рис. 7.4).

производится до точки х к+

1 , в которой достигается максимальное значение функции f

(х

) в направлении градиента . Затем в этой точке вновь определяется градиент, и движение совершается по прямой в направлении нового градиента до точки х к+

2 , в которой достигается максимальное в этом направлении значение f

(x

). Движение продолжается до тех пор, пока не будет достигнута точка х

*, соответствующая наибольшему значению целевой функции f

(x

). На рис. 7.5 приведена схема движения к оптимальной точке х

* методом наискорейшего подъема. В данном случае направление градиента в точке х k

является касательным к линии уровня поверхности f

(х

) в точке х к+

1 , следовательно, градиент в точкех к+

1 ортогонален градиенту (сравните с рис. 7.4).

Перемещение из точки х k в точку сопровождается возрастанием функции f (x ) на величину

Из выражения (7.30) видно, что приращение является функцией переменной , т. е. . При нахождении максимума функции f (x) в направлении градиента ) необходимо выбирать шаг перемещения (множитель ), обеспечивающий наибольшее возрастание приращению функции, именно функции . Величина , при которой достигается наибольшее значение , может быть определена из необходимого условия экстремума функции :

![]() (7.31)

(7.31)

Найдем выражение для производной, дифференцируя равенство (7.30) по как сложную функцию:

Подставляя этот результат в равенство (7.31), получаем

Это равенство имеет простое геометрическое истолкование: градиент в очередной точке х к+ 1 , ортогонален градиенту в предыдущей точке х к .

построены линии уровня этой поверхности. С этой целью уравнение приведено к виду (x 1 -1) 2 +(x 2 -2) 2 =5-0,5f , из которого ясно, что линиями пересечения параболоида с плоскостями, параллельными плоскости x 1 Оx 2 (линиями уровня), являются окружности радиусом . При f =-150, -100, -50 их радиусы равны соответственно

I шаг . Вычисляем:

На рис. 7.6 с началом в точке х 0 =(5; 10) построен вектор 1/16, указывающий направление наискорейшего возрастания функции в точке х 0 . На этом направлении расположена следующая точка . В этой точке .

Используя условие (7.32), получаем

или 1-4=0, откуда =1/4. Так как , то найденное значение является точкой максимума . Находим x 1 =(5-16/4; 10-32/4)=(1; 2).

II шаг . Начальная точка для второго шага x 1 =(1; 2). Вычисляем =(-4∙1 +4; -4∙2+8)=(0; 0). Следовательно, х 1 =(1; 2) является стационарной точкой. Но поскольку данная функция вогнутая, то в найденной точке (1; 2) достигается глобальный максимум.

Задача с линейными ограничениями. Сразу же отметим, что если целевая функция f (х ) в задаче с ограничениями имеет единственный экстремум и он находится внутри допустимой области, то для поиска экстремальной точки х * применяется изложенная выше методика без каких-либо изменений.

Рассмотрим задачу выпуклого программирования с линейными ограничениями:

![]() (7.34)

(7.34)

Предполагается, что f (х ) является вогнутой функцией и имеет непрерывные частные производные в каждой точке допустимой области.

Начнем с геометрической иллюстрации процесса решения задачи (рис. 7.7). Пусть начальная точка х

0 расположена внутри допустимой области. Из точки х

0 можно двигаться в направлении градиента , пока f

(x

) не достигнет максимума. В нашем случае f

(x

) все время возрастает, поэтому остановиться надо в точке х

, на граничной прямой. Как видно из рисунка, дальше двигаться в направлении градиента нельзя, так как выйдем из допустимой области. Поэтому надо найти другое направление перемещения, которое, с одной стороны, не выводит из допустимой области, а с другой - обеспечивает наибольшее возрастание f

(x

). Такое направление определит вектор , составляющий с вектором наименьший острый угол по сравнению с любым другим вектором, выходящим из точки x i

и лежащим в допустимой области. Аналитически такой вектор найдется из условия максимизации скалярного произведения ![]() . В данном случае вектор указывающий наивыгоднейшее направление, совпадает с граничной прямой.

. В данном случае вектор указывающий наивыгоднейшее направление, совпадает с граничной прямой.

|

Таким образом, на следующем шаге двигаться надо по граничной прямой до тех пор, пока возрастает f (x ); в нашем случае - до точки х 2 . Из рисунка видно, что далее следует перемещаться в направлении вектора , который находится из условия максимизации скалярного произведения

Рассмотрим теперь аналитическое решение задачи (7.33) - (7.35). Если оптимизационный поиск начинается с точки, лежащей в допустимой области (все ограничения задачи выполняются как строгие неравенства), то перемещаться следует по направлению градиента так, как установлено выше. Однако теперь выбор λ k в уравнении (7.29) усложняется требованием, чтобы очередная точка оставалась в допустимой области. Это означает, что ее координаты должны удовлетворять ограничениям (7.34), (7.35), т. е. должны выполняться неравенства:

(7.36)

(7.36)

Решая систему линейных неравенств (7.36), находим отрезок допустимых значений параметра λ k , при которых точка х k +1 будет принадлежать допустимой области.

Значение λ k * , определяемое в результате решения уравнения (7.32):

При котором f (x ) имеет локальный максимум по λ k в направлении, должно принадлежать отрезку . Если же найденное значение λ k выходит за пределы указанного отрезка, то в качестве λ k * принимается . В этом случае очередная точка поисковой траектории оказывается на граничной гиперплоскости, соответствующей тому неравенству системы (7.36), по которому при решении системы получена правая конечная точка . отрезка допустимых значений параметра λ k .

Если оптимизационный поиск начат с точки, лежащей на граничной гиперплоскости, или очередная точка поисковой траектории оказалась на граничной гиперплоскости, то для продолжения движения к точке максимума прежде всего необходимо найти наилучшее направление движения С этой целью следует решить вспомогательную задачу математического программирования, а именно- максимизировать функцию

при ограничениях

для тех t , при которых

где  .

.

В результате решения задачи (7.37) - (7.40) будет найден вектор , составляющий с градиентом наименьший острый угол.

Условие (7.39) говорит о том, что точка принадлежит границе допустимой области, а условие (7.38) означает, что перемещение из по вектору будет направлено внутрь допустимой области или по ее границе. Условие нормализации (7.40) необходимо для ограничения величины , так как в противном случае значение целевой функции (7.37) можно сделать сколь угодно большим Известны различные формы условий нормализации, и в зависимости от этого задача (7.37) - (7.40) может быть линейной или нелинейной.

После определения направления находится значение λ k *

для следующей точки ![]() поисковой траектории. При этом используется необходимое условие экстремума в форме, аналогичной уравнению (7.32), но с заменой на вектор , т. е.

поисковой траектории. При этом используется необходимое условие экстремума в форме, аналогичной уравнению (7.32), но с заменой на вектор , т. е.

![]() (7.41)

(7.41)

Оптимизационный поиск прекращается, когда достигнута точка x k *

, в которой ![]() .

.

Пример 7.5. Максимизировать функцию при ограничениях

Решение. Для наглядного представления процесса оптимизации будем сопровождать его графической иллюстрацией. На рис 7.8 изображено несколько линий уровня данной поверхности и допустимая область ОАВС, в которой следует найти точку х *, доставляющую максимум данной функции (см. пример 7 4).

Начнем оптимизационный поиск, например с точки х 0 =(4, 2,5), лежащей на граничной прямой АВ x 1 +4x 2 =14. При этом f (х 0)=4,55.

Найдем значение градиента

в точке x 0 . Кроме того, и по рисунку видно, что через допустимую область проходят линии уровня с пометками более высокими, чем f (x 0)=4,55. Словом, надо искать направление r 0 =(r 01 , r 02) перемещения в следующую точку x 1 более близкую к оптимальной. С этой целью решаем задачу (7.37) - (7.40) максимизации функции при ограничениях

|

Поскольку точка х 0 располагается только на одной (первой) граничной прямой (i =1) x 1 +4x 2 =14, то условие (7.38) записывается в форме равенства.

Система ограничительных уравнений этой задачи имеет только два решения (-0,9700; 0,2425) и (0,9700;-0,2425) Непосредственной подстановкой их в функцию T 0 устанавливаем, что максимум Т 0 отличен от нуля и достигается при решении (-0,9700; 0,2425) Таким образом, перемещаться из х 0 нужно по направлению вектора r 0 =(0,9700; 0,2425), т е по граничной прямой ВА.

Для определения координат следующей точки x 1 =(x 11 ; x 12)

(7.42)

(7.42)

необходимо найти значение параметра , при котором функция f (x ) в точке x

откуда =2,0618. При этом =-0,3999<0. Значит,=2,0618. По формуле (7.42) находим координаты новой точки х 1 (2; 3).

Если продолжить оптимизационный поиск, то при решении очередной вспомогательной задачи (7.37)- (7.40) будет установлено, что Т 1 =![]() , а это говорит о том, что точка x 1 является точкой максимума х* целевой функции в допустимой области. Это же видно и из рисунка в точке x 1 одна из линий уровня касается границы допустимой области. Следовательно, точка x 1 является точкой максимума х*. При этом f

max =f

(x

*)=5,4.

, а это говорит о том, что точка x 1 является точкой максимума х* целевой функции в допустимой области. Это же видно и из рисунка в точке x 1 одна из линий уровня касается границы допустимой области. Следовательно, точка x 1 является точкой максимума х*. При этом f

max =f

(x

*)=5,4.

|

Задача с нелинейными ограничениями. Если в задачах с линейными ограничениями движение по граничным прямым оказывается возможным и даже целесообразным, то при нелинейных ограничениях, определяющих выпуклую область, любое как угодно малое перемещение из граничной точки может сразу вывести за пределы области допустимых решений, и возникнет необходимость в возвращении в допустимую область (рис. 7.9). Подобная ситуация характерна для задач, в которых экстремум функции f (x ) достигается на границе области. В связи с этим применяются различные

способы перемещения, обеспечивающие построение последовательности точек, расположенных вблизи границы и внутри допустимой области, или зигзагообразное движение вдоль границы с пересечением последней. Как видно из рисунка, возврат из точки x 1 в допустимую область следует осуществлять вдоль градиента той граничной функции , которая оказалась нарушенной. Это обеспечит отклонение очередной точки х 2 в сторону точки экстремума х*. Признаком экстремума в подобном случае будет коллинеарность векторов и .

Лекция 6.

Градиентные методы решения задач нелинейного программирования.

Вопросы: 1. Общая характеристика методов.

2. Метод градиента.

3. Метод наискорейшего спуска.

4. Метод Франка-Фулфа.

5. Метод штрафных функций.

1. Общая характеристика методов.

Градиентные методы представляют собой приближенные (итерационные) методы решения задачи нелинейного программирования и позволяют решить практически любую задачу. Однако при этом определяется локальный экстремум. Поэтому целесообразно применять эти методы для решения задач выпуклого программирования, в которых каждый локальный экстремум является и глобальным. Процесс решения задачи состоит в том, что, начиная с некоторой точки х (начальной), осуществляется последовательный переход в направлении gradF(x), если определяется точка максимума, и –gradF(x) (антиградиента), если определяется точка минимума, до точки, являющейся решением задачи. При этом эта точка может оказаться как внутри области допустимых значений, так и на ее границе.

Градиентные методы можно разделить на два класса (группы). К первой группе относятся методы, в которых все исследуемые точки принадлежат допустимой области. К таким методам относятся: метод градиента, наискорейшего спуска, Франка-Вулфа и др. Ко второй группе относятся методы, в которых исследуемые точки могут и не принадлежать допустимой области. Общим из таких методов является метод штрафных функций. Все методы штрафных функций отличаются друг от друга способом определения «штрафа».

Основным понятием, используемым во всех градиентных методах, является понятие градиента функции, как направления наискорейшего возрастания функции.

При определении решения градиентными методами итерационный процесс продолжается до тех пор, пока:

Либо grad F(x*) = 0, (точное решение);

где

- две последовательные точки,

- две последовательные точки, -

малое число, характеризующее точность

решения.

-

малое число, характеризующее точность

решения.

2. Метод градиента.

Представим человека, стоящего на склоне оврага, которому необходимо спуститься вниз (на дно). Наиболее естественным, кажется, направление в сторону наибольшей крутизны спуска, т.е. направление (-grad F(x)). Получаемая при этом стратегия, называемая градиентным методом , представляет собой последовательность шагов, каждый из которых содержит две операции:

а) определение направления наибольшей крутизны спуска (подъема);

б) перемещение в выбранном направлении на некоторый шаг.

Правильный выбор шага имеет существенное значение. Чем шаг меньше, тем точнее результат, но больше вычислений. Различные модификации градиентного метода и состоят в использовании различных способов определения шага. Если на каком-либо шаге значение F(x) не уменьшилось, это означает, что точку минимума «проскочили», в этом случае необходимо вернуться к предыдущей точке и уменьшить шаг, например, вдвое.

Схема решения.

принадлежащей допустимой области

3. Выбор шага h.

x (k+1)

= x (k)

«-» - если min.

5. Определение F(x (k +1)) и:

Если

,

решение найдено;

,

решение найдено;

Замечание. Если grad F(x (k)) = 0, то решение будет точным.

Пример.

F(x) = -6x 1

+ 2x 1 2

– 2x 1 x 2

+ 2x 2 2

min,

min,

x 1 +x 2

2,x 1

2,x 1

0, x 2

0, x 2

0,

0, = 0,1.

= 0,1.

3. Метод наискорейшего спуска.

В отличие от метода градиента, в котором градиент определяют на каждом шаге, в методе наискорейшего спуска градиент находят в начальной точке и движение в найденном направлении продолжают одинаковыми шагами до тех пор, пока значение функции уменьшается (увеличивается). Если на каком-либо шаге F(x) возросло (уменьшилось), то движение в данном направлении прекращается, последний шаг снимается полностью или наполовину и вычисляется новое значение градиента и новое направление.

Схема решения.

1. Определение х 0 = (х 1 ,x 2 ,…,x n),

принадлежащей допустимой области,

и F(x 0), k = 0.

2. Определение grad F(x 0) или –gradF(x 0).

3. Выбор шага h.

4. Определение следующей точки по формуле

x (k+1)

= x (k)

h grad F(x (k)),

«+» - если max,

h grad F(x (k)),

«+» - если max,

«-» - если min.

5. Определение F(x (k +1)) и:

Если

,

решение найдено;

,

решение найдено;

Если нет:

а) при поиске min: - если F(x (k +1))

Если F(x (k +1))

>F(x (k))

– переход к п. 2; б) при поиске max: -

еслиF(x (k +1))

>F(x (k))

– переход к п. 4; Если F(x (k +1))

Замечания:

1. Если grad F(x (k))

= 0, то решение будет точным. 2. Преимуществом метода

наискорейшего спуска является его

простота и сокращение расчетов, так

как grad F(x) вычисляется не во всех точках,

что важно для задач большой

размерности. 3. Недостатком является то,

что шаги должны быть малыми, чтобы не пропустить точку оптимума. Пример.

F(x) = 3x 1

– 0,2x 1 2

+ x 2 -

0,2x 2 2

x 1

+ x 2

x 1

+ 2x 2

4. Метод Франка-Вулфа.

Метод используется для оптимизации

нелинейной целевой функции при линейных

ограничениях. В окрестности исследуемой

точки нелинейная целевая функция

заменяется линейной функцией и задача

сводится к последовательному решению

задач линейного программирования. Схема решения.

1. Определение х 0 = (х 1 ,x 2 ,…,x n),

принадлежащей допустимой области, и

F(x 0), k = 0. 2. Определение grad F(x (k)). 3. Строят функцию 4. Определение max(min)f(x) при

исходных ограничениях. Пусть это будет

точка z (k) . 5. Определение шага вычислений x (k +1) =x (k) +

6. Определение F(x (k +1))

и проверяют необходимость дальнейших

вычислений: Если

Если нет, то переход к п. 2. Пример.

F(x) = 4x 1

+ 10x 2

–x 1 2

–x 2 2

x 1

+x 2 x 2

5. Метод штрафных функций.

Пусть необходимо найти F(x 1 ,x 2 ,…,x n)

g i

(x 1 ,

x 2 ,…,x n)

Функции F и g i –

выпуклые или вогнутые. Идея метода штрафных функций

заключается в поиске оптимального

значения новой целевой функции Q(x) = F(x)

+ H(x), которая является суммой исходной

целевой функции и некоторой функции

H(x), определяемой системой ограничений

и называемой штрафной функцией. Штрафные

функции строят таким образом, чтобы

обеспечить либо быстрое возвращение в

допустимую область, либо невозможность

выходы из нее. Метод штрафных функций

сводит задачу на условный экстремум к

решению последовательности задач на

безусловный экстремум, что проще.

Существует множество способов построения

штрафной функции. Наиболее часто она

имеет вид: H(x) =

где

Примечание

: Чем меньше

Начинают решение с малых

Используя штрафную функцию,

последовательно переходят от одной

точки к другой до тех пор, пока не получат

приемлемое решение. Схема решения.

1. Определение начальную точку х 0 = (х 1 ,x 2 ,…,x n),

F(x 0) и k = 0. 2. Выбирают шаг вычислений h. 3. Определяют частные производные

4. Определяют координаты следующей точки

по формуле: x j (k +1) 5. Если x (k +1) а) если

б) если grad F(x (k +1))

= 0, то найдено точное решение. Если x (k +1) Пример.

F(x) = – x 1 2

– x 2 2

(x 1

-5) 2 +(x 2

-5) 2 Рассмотрим задачу безусловной минимизации дифференцируемой функции многих переменных Пусть приближение к точке минимума значение градиента в точке Выше уже отмечалось, что в малой окрестности точки направление наискорейшего убывания функции задается антиградиентом Это свойство существенно используется в ряде методов минимизации. В рассматриваемом Ниже градиентном методе за направление спуска из точки непосредственно выбирается Таким образом, согласно градиентному методу Существуют различные способы выбора шага каждый из которых задает определенный вариант градиентного метода. Рассмотрим функцию одной скалярной переменной и выберем в качестве то значение, для которого выполняется равенство Этот метод, предложенный в 1845 г. О. Коши, принято теперь называть методом наискорейшего спуска. На рис. 10.5 изображена геометрическая иллюстрация этого метода для минимизации функции двух переменных. Из начальной точки перпендикулярно линии уровня в направлении спуск продолжают до тех пор, пока не будет достигнуто минимальное вдоль луча значение функции . В найденной точке этот луч касается линии уровня Затем из точки проводят спуск в перпендикулярном линии уровня направлении до тех пор, пока соответствующий луч не коснется в точке проходящей через эту точку линии уровня, и т. д. Отметим, что на каждой итерации выбор шага предполагает решение задачи одномерной минимизации (10.23). Иногда эту операцию удается выполнить аналитически, например для квадратичной функции. Применим метод наискорейшего спуска для минимизации квадратичной функции с симметричной положительно определенной матрицей А. Согласно формуле (10.8), в этом случае Поэтому формула (10.22) выглядит здесь так: Заметим, что Эта функция является квадратичной функцией параметра а и достигает минимума при таком значении для которого Таким образом, применительно к минимизации квадратичной функции (10.24) метод наискорейшего спуска эквивалентен расчету по формуле (10.25), где Замечание 1. Поскольку точка минимума функции (10.24) совпадает с решением системы метод наискорейшего спуска (10.25), (10.26) может применяться и как итерационный метод решения систем линейных алгебраических уравнений с симметричными положительно определенными матрицами. Замечание 2. Отметим, что где отношение Рэлея (см. § 8.1). Пример 10.1. Применим метод наискорейшего спуска для минимизации квадратичной функции Заметим, что Поэтому точное значение точки минимума нам заранее известно. Запишем данную функцию в виде (10.24), где матрица и вектор Как нетрудно видеть, Возьмем начальное приближение и будем вести вычисления по формулам (10.25), (10.26). I итерация. II итерация. Можно показать, что для всех на итерации будут получены значения Заметим, что при Таким образом, последовательность полученная методом наискорейшего спуска, сходится со скоростью геометрической прогрессии, знаменатель которой На рис. 10.5 изображена именно та траектория спуска, которая была получена в данном примере. Для случая минимизации квадратичной функции справедлив следующий общий результат . Теорема 10.1. Пусть А - симметричная положительно определенная матрица и минимизируется квадратичная функция (10.24). Тогда при любом выборе начальною приближения метод наискорейшею спуска (10.25), (10.26) сходится и верна следующая оценка погрешности: Здесь и Ладо - минимальное и максимальное собственные значения матрицы А. Отметим, что этот метод сходится со скоростью геометрической прогрессии, знаменатель которой причем если их близки, то мало и метод сходится достаточно быстро. Например, в примере 10.1 имеем и поэтому Если же Ащах, то и 1 и следует ожидать медленной сходимости метода наискорейшего спуска. Пример 10.2. Применение метода наискорейшего спуска для минимизации квадратичной функции при начальном приближении дает последовательность приближений где Траектория спуска изображена на рис. 10.6. Последовательность сходится здесь со скоростью геометрической прогрессии, знаменатель которой равен т. е. существенно медленнее, чем в предыдущем примерю. Так как здесь и полученный результат вполне согласуется с оценкой (10.27). Замечание 1. Мы сформулировали теорему о сходимости метода наискорейшего спуска в случае, когда целевая функция является квадратичной. В общем случае, если минимизируемая функция строго выпуклая и имеет точку минимума х, то также независимо от выбора начального приближения полученная указанным методом последовательность сходится к х при . При этом после попадания в достаточно малую окрестность точки минимума сходимость становится линейной и знаменатель соответствующей геометрической прогрессии оценивается сверху величиной и где и минимальное и максимальное собственные числа матрицы Гессе Замечание 2. Для квадратичной целевой функции (10.24) решение задачи одномерной минимизации (10.23) удается найти в виде простой явной формулы (10.26). Однако для большинства других нелинейных функций этого сделать нельзя и для вычисления методом наискорейшего спуска приходится применять численные методы одномерной минимизации типа тех, которые были рассмотрены в предыдущей главе. Из проведенного выше обсуждения следует, что градиентный метод сходится достаточно быстро, если для минимизируемой функции поверхности уровня близки к сферам (при линии уровня близки к окружностям). Для таких функций и 1. Теорема 10.1, замечание 1, а также результат примера 10.2 указывают на то, что скорость сходимости резко падает при увеличении величины Действительно, известно, что градиентный метод сходится очень медленно, если поверхности уровня минимизируемой функции сильно вытянуты в некоторых направлениях. В двумерном случае рельеф соответствующей поверхности напоминает рельеф местности с оврагом (рис. 10.7). Поэтому такие функции принято называть овражными. Вдоль направлений, характеризующих "дно оврага", овражная функция меняется незначительно, а в других направлениях, характеризующих "склон оврага", происходит резкое изменение функции. Если начальная точка попадает на "склон оврага", то направление градиентного спуска оказывается почти перпендикулярным "дну оврага" и очередное приближение попадает на противоположный "склон оврага". Следующий шаг в направлении ко "дну оврага" возвращает приближение на первоначальный "склон оврага". В результате вместо того чтобы двигаться вдоль "дна оврага" в направлении к точке минимума, траектория спуска совершает зигзагообразные скачки поперек "оврага", почти не приближаясь к цели (рис. 10.7). Для ускорения сходимости градиентного метода при минимизации овражных функций разработан ряд специальных "овражных" методов. Дадим представление об одном из простейших приемов. Из двух близких начальных точек совершают градиентный спуск на "дно оврага". Через найденные точки проводят прямую, вдоль которой совершают большой "овражный" шаг (рис. 10.8). Из найденной таким образом точки снова делают один шаг градиентного спуска в точку Затем совершают второй "овражный" шаг вдоль прямой, проходящей через точки . В результате движение вдоль "дна оврага" к точке минимума существенно ускоряется. Более подробную информацию о проблеме "оврагов" и "овражных" методах можно найти, например, в , . Как нетрудно понять, на каждой итерации было бы желательно выбирать направление спуска близкое к тому направлению, перемещение вдоль которого приводит из точки в точку х. К сожалению, антиградиент (является, как правило, неудачным направлением спуска. Особенно ярко это проявляется для овражных функций. Поэтому возникает сомнение в целесообразности тщательного поиска решения задачи одномерной минимизации (10.23) и появляется желание сделать в направлении лишь такой шаг, который бы обеспечил "существенное убывание" функции Более того, на практике иногда довольствуются определением значения которое просто обеспечивает уменьшение значения целевой функции. Как мы уже отметили, задача оптимизации – это задача отыскания таких значений факторов х

1 = х

1* , х

2 = х

2* , …, х

k

= х

k

*

, при которых функция отклика (у

) достигает экстремального значения у

= ext (оптимума). Известны различные методы решения задачи оптимизации. Одним из наиболее широко применяемых является метод градиента, называемый также методом Бокса-Уилсона и методом крутого восхождения. Рассмотрим сущность метода градиента на примере двухфакторной функции отклика y =

f(x

1 , х

2 ).

На рис. 4.3 в факторном пространстве изображены кривые равных значений функции отклика (кривые уровня). Точке с координатами х

1 *, х

2 * соответствует экстремальное значение функции отклика у

ext . Если мы выберем какую-либо точку факторного пространства в качестве исходной (х

1 0 , х

2 0), то наикратчайший путь к вершине функции отклика из этой точки – это путь, по кривой, касательная к которой в каждой точке совпадает с нормалью к кривой уровня, т.е. это путь в направлении градиента функции отклика. Градиент непрерывной однозначной функции y =

f

(x

1 , х

2) – это вектор, определяемый по направлению градиентом с координатами: где i,

j

– единичные векторы в направлении осей координат х

1 и х

2 . Частные производные и характеризуют направление вектора. Поскольку нам неизвестен вид зависимости y =

f

(x

1 , х

2), мы не можем найти частные производные , и определить истинное направление градиента. Согласно методу градиента в какой-то части факторного пространства выбирается исходная точка (исходные уровни) х

1 0 , х

2 0 . Относительно этих исходных уровней строится симметричный двухуровневый план эксперимента. Причем интервал варьирования выбирается настолько малым, чтобы линейная модель оказалась адекватной. Известно, что любая кривая на достаточно малом участке может быть аппроксимирована линейной моделью. После построения симметричного двухуровневого плана решается интерполяционная задача, т.е. строится линейная модель: и проверяется ее адекватность. Если для выбранного интервала варьирования линейная модель оказалась адекватной, то может быть определено направление градиента: Таким образом, направление градиента функции отклика определяется значениями коэффициентов регрессии. Это означает, что мы будем двигаться в направлении градиента, если из точки с координатами (

) перейдем в точку с координатами: где m –

положительное число, определяющее величину шага в направлении градиента. Поскольку х

1 0 = 0 и х

2 0 = 0, то Определив направление градиента () и выбрав величину шага m

, осуществляем опыт на исходном уровне х

1 0 , х

2 0 . Как только в очередном опыте значение функции отклика уменьшилось, движение по градиенту прекращают, принимают опыт с максимальным значением функции отклика за новый исходный уровень, составляют новый симметричный двухуровневый план и снова решают интерполяционную задачу. Построив новую линейную модель фициент , значит, область экстремума функции отклика (область оптимума) еще не достигнута. Определяется новое направление градиента и начинается движение к области оптимума. Уточнение направления градиента и движение по градиенту продолжаются до тех пор, пока в процессе решения очередной интерполяционной задачи проверка значимости факторов не покажет, что все факторы незначимы, т.е. все . Это означает, что область оптимума достигнута. На этом решение оптимизационной задачи прекращают, и принимают опыт с максимальным значением функции отклика за оптимум. В общем виде последовательность действий, необходимых для решения задачи оптимизации методом градиента, может быть представлена в виде блок-схемы (рис. 4.4). 1) исходные уровни факторов (х

j

0) следует выбирать возможно ближе к точке оптимума, если есть какая-то априорная информация о ее положении; 2) интервалы варьирования (Δх

j

) надо выбирать такими, чтобы линейная модель наверняка оказалась адекватной. Границей снизу Δх

j

при этом является минимальное значение интервала варьирования, при котором функция отклика остается значимой; 3) значение шага (т

) при движении по градиенту выбирают таким образом, чтобы наибольшее из произведений не превышало разности верхнего и нижнего уровней факторов в нормированном виде Следовательно, . При меньшем значении т

разность функции отклика в исходном уровне и в точке с координатами может оказаться незначимой. При большем значении шага возникает опасность проскочить оптимум функции отклика. max,

max, 7, x 1

7, x 1

0,

0, 10, x 2

10, x 2

0.

0. (min – «-»;max– «+»).

(min – «-»;max– «+»). (k) (z (k) –x (k)),

где

(k) (z (k) –x (k)),

где

(k) – шаг, коэффициент, 0

(k) – шаг, коэффициент, 0

1.

1.

(k) выбирается так, чтобы значение функции

F(x) было max (min) в точке х (k +1) .

Для этого решают уравнение

(k) выбирается так, чтобы значение функции

F(x) было max (min) в точке х (k +1) .

Для этого решают уравнение и

выбирают наименьший (наибольший) из

корней, но 0

и

выбирают наименьший (наибольший) из

корней, но 0

1.

1. или grad F(x (k +1))

= 0, то решение найдено;

или grad F(x (k +1))

= 0, то решение найдено; max,

max, 4, x 1

4, x 1

0,

0, 2, x 2

2, x 2

0.

0. max(min),

max(min), b i , i

=

b i , i

=

, x j

, x j

0, j =

0, j = .

. ,

,

-

некоторые положительные Const.

-

некоторые положительные Const. ,

тем быстрее находится решение, однако,

точность снижается;

,

тем быстрее находится решение, однако,

точность снижается; и увеличивают их на последующих шагах.

и увеличивают их на последующих шагах. и

и .

. .

. Допустимой

области, проверяют:

Допустимой

области, проверяют: -

решение найдено, если нет – переход к

п. 2.

-

решение найдено, если нет – переход к

п. 2. Допустимой области, задают новое значение

Допустимой области, задают новое значение и

переходят к п. 4.

и

переходят к п. 4. max,

max, 8, x 1

8, x 1

0, x 2

0, x 2

0.

0.1. Метод наискорейшего спуска.

![]()

![]()

![]()

2. Проблема "оврагов".

3. Другие подходы к определению шага спуска.

![]()

![]()

![]()

![]() .

.

Затем делаем шаг в направлении градиента, т.е. осуществляем опыт в точке с координатами . Если значение функции отклика возросло по сравнению с ее значением в исходном уровне, делаем еще шаг в направлении градиента, т.е. осуществляем опыт в точке с координатами:

Движение по градиенту продолжаем до тех пор, пока функция отклика не начнет уменьшаться. На рис. 4.3 движение по градиенту соответствует прямой, выходящей из точки (х

1 0 , х

2 0). Она постепенно отклоняется от истинного направления градиента, показанного штриховой линией, вследствие нелинейности функции отклика.

Движение по градиенту продолжаем до тех пор, пока функция отклика не начнет уменьшаться. На рис. 4.3 движение по градиенту соответствует прямой, выходящей из точки (х

1 0 , х

2 0). Она постепенно отклоняется от истинного направления градиента, показанного штриховой линией, вследствие нелинейности функции отклика.![]() , осуществляют регрессионный анализ. Если при этом проверка значимости факторов показывает, что хоть один коэф

, осуществляют регрессионный анализ. Если при этом проверка значимости факторов показывает, что хоть один коэф![]() .

.